Transformer 架构

1. 概述

- Transformer = 注意力机制 + 全连接层 + 残差连接 + 归一化。

- Transformer 靠自注意力(Self-Attention)捕捉全局依赖,不再依赖循环(RNN/LSTM)。

- 2017 年谷歌提出,现在所有大模型的底层骨架。

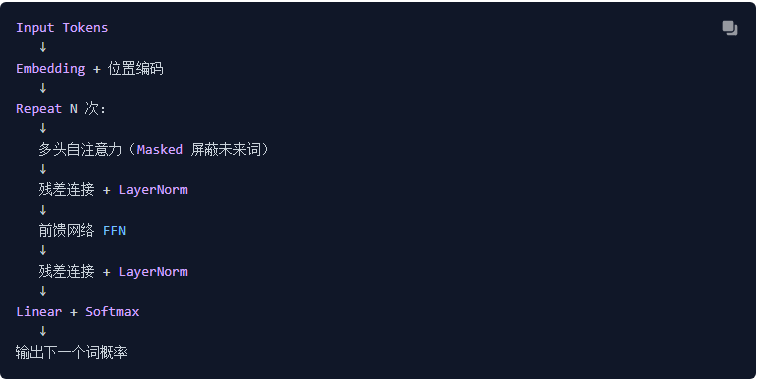

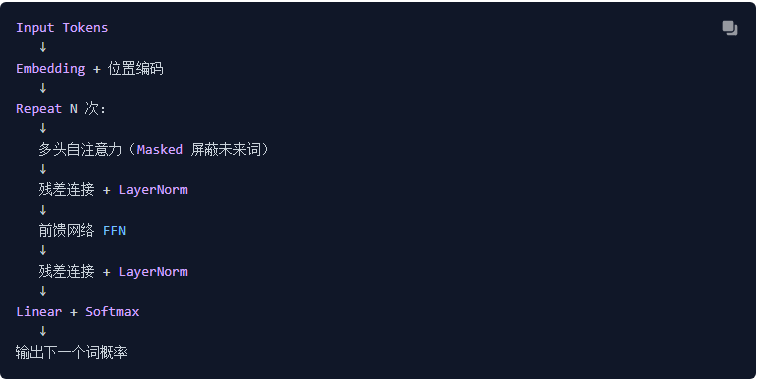

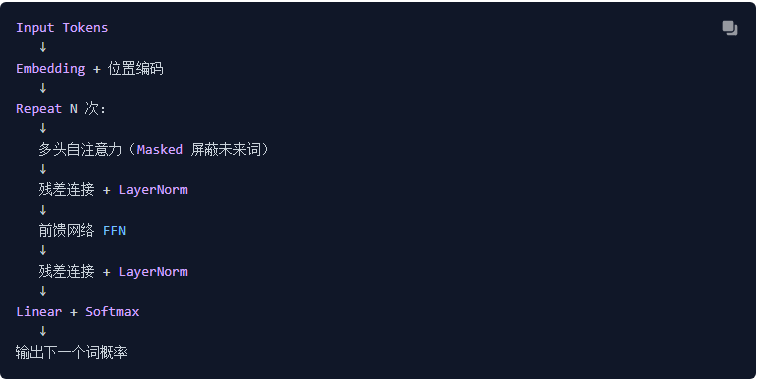

2. 标准结构

- Encoder(编码器) → 理解输入

- Decoder(解码器) → 生成输出

通用大模型(LLM)只用 Decoder-only。

3. 核心组件

- 把 token 变成向量,让模型能看懂。

- Positional Encoding(位置编码)

- Transformer 没有时序,必须告诉它词的顺序。

- Multi-Head Self-Attention(多头自注意力)

- Transformer 的灵魂。

- 把一句话里每个词和所有词关联

- 自动学习:谁重要、谁和谁相关

- 多头 = 同时关注不同类型关系

- Feed Forward Network(FFN)

- 两层全连接,做特征变换。

- 防止深层网络梯度消失。

- 稳定训练,让分布更平稳。

4. Transformer优势

- 并行计算(RNN 不能)

- 长距离依赖捕捉极强

- 可堆叠超深(几十~上百层)

- 适合大规模预训练